@风中的厂长:我现在经常用AI辅助工作,发现AI这样发展下去很危险啊。网上查了一下,大量AI诈骗案例都是今年的。大家一定长个心眼。举几个高危的例子:希望这条微博能帮助你们避雷。就算自己不会上当,也要转给家人。特别是老年人很容易上当。

前几天骗子用AI虚拟了一个“张文宏”带货蛋白棒,很多老年人深信不疑,纷纷下单。

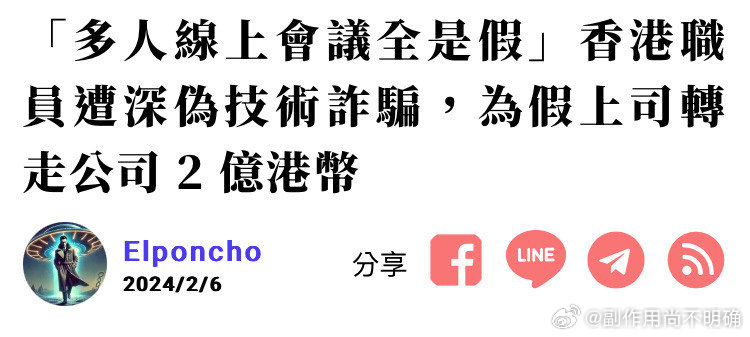

前一阵福州老板郭总接到好友微信视频电话,要借430万元用来竞标,因为是好朋友,微信视频又很真实就没多想,郭老板就分两笔转了430万。过了一阵郭总发现,“好友”是AI合成的。

还有“宁夏表哥”案,今年马某接到表哥的视频电话求助,分三次将15000元转到对方指定账户,后来才发现视频是AI合成的。

还有AI语音模拟亲人的声音进行诈骗。杨女士收到上大学的女儿语音留言要钱。杨女士一听是女儿,毫不犹豫转账了35000元,结果这个“女儿”的声音是AI模拟的

微信扫一扫打赏

微信扫一扫打赏 支付宝扫一扫打赏

支付宝扫一扫打赏:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/1_jr3sb.webp)

:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/112_zffcp.webp)

:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/nimg-ws-126_uzsx4.webp)

:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/2_3amsv.webp)

:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/1_fwpe8.webp)

:format(webp):quality(80)/https://assets.bohaishibei.com/2025/12/23/112_a3w98.webp)